Es geht endlich weiter

Zunächst einmal sorry für die lange Funkstille auf diesem Blog. Diese war gleich mehreren Gründen geschuldet. Zum einen habe ich mich in den letzten Monaten eher mit dem Thema „Blockchain“ beschäftigt – einer langjährigen On-Off-Beziehung von mir, die mir aber thematisch nicht so recht zum Blog zu passen scheint.

Außerdem kämpfe ich schon länger damit, dass vom ursprünglichen Thema dieses Blogs (dem Algorithmischen Denken) kaum noch die Rede ist. Dieser Trend hat ja schon recht früh eingesetzt, weil sich meine Interessen seit Anfang 2022 zunehmend in Richtung Bayes’sche Statistik, Network Science und Theorie Komplexer Systeme verschoben haben.

Die Kluft zwischen Neuronen und Algorithmen

Seit Anfang 2023 ist aber noch ein weiterer Grund hinzugekommen. Der Siegeszug generativer „KIs“ (wie etwa ChatGPT) wirft nämlich die Frage auf, wie sinnvoll es noch ist, Denken überhaupt algorithmisch beschreiben zu wollen.

Um das zu erklären, muss ich etwas weiter ausholen. Es ist nämlich schon lange bekannt, dass das menschliche Gehirn intern keinesfalls algorithmisch arbeitet. Zwar können wir unser Handeln häufig algorithmisch beschreiben („Ich fülle einen Topf mit Wasser, stelle ihn auf die Herdplatte und drehe den Regler auf die höchste Stufe. Wenn das Wasser kocht, lege ich vorsichtig fünf Eier hinein (usw.)“), doch in unserem Gehirn finden wir keine Entsprechungen für das, was wir da beobachten.

Unser Gehirn ist vielmehr ein sogenanntes emergentes komplexes System, in dem recht simple biologische Einheiten (Neuronen und Synapsen) durch Vernetzung, Zusammenarbeit, Feedback und Adaption zu einem Gesamtsystem verschmelzen, dessen Leistungsfähigkeit durch die Funktionsweise seiner Komponenten nicht mehr erklärbar ist. Das Ganze ist größer als die Summe seiner Teile, und der Reduktionismus, der seit Jahrhunderten das Grundprinzip der westlichen Wissenschaft ist (und der fordert, dass man ein Phänomen nur verstehen kann, indem man es in seine Bestandteile zerlegt), stößt hier an seine Grenzen.

Beim Verständnis des Gehirns kann man also zwischen der Mikroebene (Neuronen, Synapsen) und der Makroebene (Modelle, Algorithmen) unterscheiden. Beide werden von den entsprechenden Wissenschaften ziemlich gut verstanden, sie passen bloß überhaupt nicht zusammen. Und wir haben auch keine Ahnung, wie wir von der einen zur anderen kommen sollen.

Aus diesem Grund hat beispielsweise die Kognitionswissenschaft, deren großes Ziel es einmal war, durch das Verständnis von Computern auch das menschliche Gehirn zu verstehen, das sogenannte Computermodell des Geistes mittlerweile aufgegeben. Das menschliche Gehirn arbeitet eben nicht wie ein Computer, auch wenn wir menschliches Verhalten gerne durch algorithmische Entsprechungen wie Entscheidungen (Informatiksprech: Verzweigungen), Wiederholungen (Schleifen), zuständige Gehirnareale (Funktionen) und natürlich das Gedächtnis (Speicher) beschreiben.

Bauen statt verstehen

Das alles ist wie gesagt nicht neu, und entsprechende Überlegungen wurden schon vor etwa 35 Jahren angestellt. Was also hat sich jetzt durch ChatGPT & Co. verändert?

Mein Eindruck ist, dass mit dem Aufkommen leistungsfähiger neuronaler Netze das Bemühen, Probleme und die zugehörigen Lösungsverfahren wirklich zu verstehen, schlagartig nachgelassen hat. Der Großteil insbesondere der KI-Forschung gibt sich neuerdings damit zufrieden, Systeme für das maschinelle Lernen zu bauen. Man hat jetzt gewissermaßen eine magische Black Box (das neuronale Netz), die man einfach so lange mit Trainingsdaten füttert, bis sie tut, was man will. Warum diese „KI“ das jetzt so und nicht anders tut und wie sie dabei genau vorgeht (oder ob sie überhaupt wirklich das tut, was ursprünglich beabsichtigt war), ist nicht erfassbar und interessiert scheinbar auch gar nicht mehr. Erklärungen beschränken sich neuerdings auf Aussagen der Art: „Mit 14 Schichten ging es noch nicht, aber mit 15 hat es dann geklappt“. Aha, na dann.

Die große Ungewissheit

Das ist für mich und meinen lebenslangen Traum, das menschliche Denken zu verstehen, natürlich ausgesprochen frustrierend. Und es wirft meiner Meinung nach auch kein gutes Licht auf den Zustand der Wissenschaft, die den Wunsch, die Welt zu verstehen, bereitwillig aufgibt für den Wunsch, die Welt (dazu noch möglichst disruptiv und ohne Reflektieren der Folgen) zu verändern.

Es hat aber auf den ersten Blick auch noch viel weitreichendere, ethische Konsequenzen: Wenn wir uns von technischen Systemen Informationen liefern oder gar Entscheidungen abnehmen lassen, obwohl wir gar nicht wissen, wie diese bei der Informationsverarbeitung bzw. Entscheidungsfindung überhaupt vorgegangen sind, dann öffnen wir sowohl unabsichtlichen Missverständnissen als auch bewusstem Missbrauch Tür und Tor.

Andererseits muss man fairerweise zugeben: Eigentlich gilt genau das gleiche auch für den Menschen. Denn nach allem, was wir über unser Denken wissen, wissen auch wir so gut wie nichts darüber, wie wir zu unseren Erkenntnissen gelangen oder warum wir welche Entscheidungen wie treffen. Natürlich könenn wir häufig irgendwelche Gründe nennen, aber der Stand der psychologischen Forschung sagt, dass diese Gründe eher etwas sind, was wir uns nachträglich ausdenken – die wahren Ursachen unseres Denkens und Handelns sind uns ebenso unzugänglich wie die unserer neuen maschinellen Helferlein. So gesehen ist dieses Problem der Ungewissheit also lösbar – wir lösen es schließlich schon seit Tausenden von Jahren im Umgang mit unseren Mitmenschen!

Sind Algorithmen nun nutzlos?

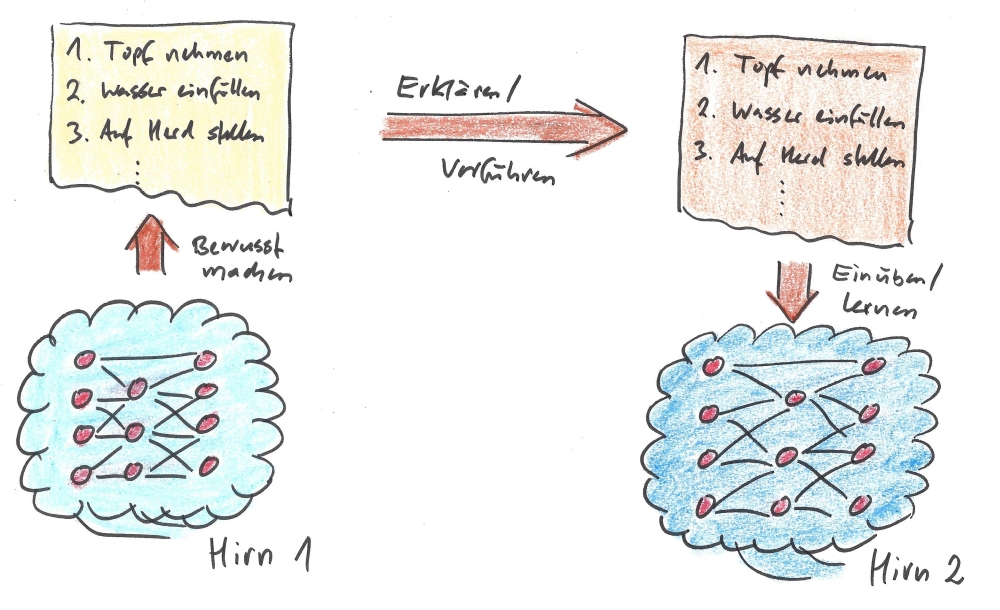

Aber auch wenn es vielleicht so klingen mag: Die obigen Überlesungen sind für mich kein Grund, das Nachdenken über Algorithmen einzustellen. Es mag sein, dass der Mensch selbst gar nicht in Algorithmen denkt und dass sich diese auch nicht in der uns bekannten Form im Gehirn wiederfinden. Dennoch nutzen wir sie, um zu beschreiben, was wir tun. Das hat den kuriosen Effekt, dass wir einander Dinge nicht beibringen können, indem wir einander „ins Gehirn schauen“. Wir generieren vielmehr aus dem neuronalen Netz unseres Gehirns, das unser Vorgehen in einer vollkommen anderen Darstellung enthält, eine verbale Beschreibung – den Algorithmus. Diesen geben wir einer anderen Person weiter, die ihn schließlich (durch Verstehen und/oder Einüben) wieder zu einem Teil ihres eigenen neuronalen Netzes macht.

Allein diese Nutzung von Algorithmen für das Lernen zeigt, dass sie weiterhin nützlich bleiben werden und dass es sich lohnt, darüber nachzudenken. Dort, wo man ein Problem sauber genug modellieren kann, können sie außerdem genutzt werden, nach möglichst eleganten (ja, manchmal sogar optimalen) Lösungswegen zu suchen. Zugleich gibt es aber auch Probleme, die aufgrund ihrer Struktur nicht dafür geeignet sind, algorithmisch gelöst zu werden, und es deutet einiges darauf hin, dass viele Probleme des Denkens in diese Kategorie fallen.

Komplexe Systeme

Zugleich bleibt natürlich die Frage spannend, wie aus den riesigen Mengen einfachster Neuronen und Synapsen (sowie dem Einfluss diverser anderer Zellen, Umweltreize, Hormone etc.) nun eigentlich das komplexe Verhalten wird, zu dem wir in der Lage sind. Der Fachbegriff hierfür ist Emergenz: Systeme aus vergleichsweise einfachen Komponenten entwickeln durch Kooperation und Adaption die Fähigkeit zu hochkomplexem Verhalten.

Für mich ist das auch deshalb interessant, weil ich bei vielen Themen, die mich interessieren, früher oder später wieder an diesem Punkt anzukommen scheine. So gelten ähnliche Prinzipien nicht nur in der Natur (von der DNA und der Organisation von Zellen über das Verhalten von Viren und Immunsystemen und die Funktionsweise von Ameisenstaaten bis ganz hinauf zur Modellierung von Ökosystemen und der Entwicklung des Klimas), sondern auch in der menschlichen Gesellschaft (beispielsweise beim Sozialverhalten, in Märkten oder in der Organisation und Generierung von Wissen). Immer geht es um Netzwerke, Informationsflüsse, Kooperation und Evolution.

Eine ganze Reihe wissenschaftlicher Disziplinen bemüht sich seit rund einem Jahrhundert, diese Phänomene zu beschreiben und zu erforschen. Sie tragen solche klangvolle Namen wie Kybernetik, Synergetik, Systemtheorie oder (in letzter Zeit) Theorie komplexer Systeme. Seit Anfang 2022 gab es in diesem Blog ja schon den einen oder anderen Beitrag, der aus diesen Disziplinen motiviert war. Und es würde mich nicht wundern, wenn das auch in Zukunft immer mal wieder der Fall wäre…