Wie man einen Eisberg übersieht

Im letzten Beitrag habe ich ja erwähnt, dass ich vor Kurzem über den Bayes’schen Wahrscheinlichkeitsbegriff gestolpert bin und dass ich einigermaßen fassungslos bin darüber, dass dieses (für etliche wissenschaftliche Diszplinen doch ziemlich wichtige) Thema bisher völlig an mir vorbeigegangen ist. Ich habe mir daher mal ein paar Gedanken gemacht, woran das liegt und ob darin vielleicht ein paar tiefere Einsichten verborgen sind.

Zunächst einmal zum „Warum“. Der Hauptgrund ist natürlich der, dass mein wissenschaftlicher Hintergrund die Informatik ist, und dort gibt es (mit Ausnahme einiger Spezialgebiete wie der KI-Forschung) meist gar keinen Grund, sich mit subjektiven Wahrscheinlichkeiten zu beschäftigen. Daher wird in Grundlagenvorlesungen (genau wie in der Schule übrigens) auch nur die klassische, frequentistische Sicht von Wahrscheinlichkeiten als relativen Häufigkeiten gelehrt. Man hat also ein Fundament, das man gut beherrscht und dessen man sich sicher ist.

Wenn man nun anfängt, in anderen Disziplinen zu wildern – so wie ich es in den letzten Jahren beispielsweise in Psychologie und Kognitionswissenschaft getan habe – gibt es natürlich schon das eine oder andere Buch, das mit Bayes’schen Wahrscheinlichkeiten (also Wahrscheinlichkeiten, mit denen keine relativen Häufigkeiten, sondern subjektives Vertrauen in die Korrektheit einer Hypothese gemeint sind) arbeitet. Dabei gibt es im Grunde zwei Fälle:

- In manchen Büchern gibt es explizite Einführungskapitel zu Bayes’schen Wahrscheinlichkeiten, aber die habe ich schlicht nicht gelesen. Denn „Wahrscheinlichkeiten“ kenne ich, und „Bayes“ (im Sinne von „Bayes’sches Gesetz“) kenne ich auch. Dass sich hinter „Bayes’sche Wahrscheinlichkeiten“ etwas ganz anderes verbirgt, war mir nicht klar. Und ich kann mich nur damit trösten, dass auch Thomas Bayes höchstselbst überrascht gewesen wäre, denn der Begriff kam erst etwa 200 Jahre nach seinem Tod auf für ein Konzept, das gar nicht von ihm, sondern von Pierre-Simon Laplace stammt.

- In manchen Büchern wird auch einfach nur implizit mit Bayes’schen Wahrscheinlichkeiten gearbeitet. Was für mich im Grunde auf das gleiche hinausläuft wie explizite Einführungskapitel, die ich überblättert habe. In beiden Fällen muss ich mir eben „on the fly“ einen Reim auf das machen, was ich da lese, und das hat mich noch nicht einmal stutzig gemacht, weil (1) die mathematische Mechanik exakt die gleiche ist wie bei klassischen Wahrscheinlichkeiten ich (2) beim interdisziplinären Lesen ohnehin nicht immer alles verstehe.

Und dann stolpere ich eben irgendwann über die Erkenntnis, dass so manches Buch, das ich in den letzten beiden Jahren in Händen hatte, mit dem Wort „Wahrscheinlichkeit“ etwas ganz anderes meinte als das, was ich darunter verstanden habe. Gerade komme ich mir vor wie der Kapitän, vor dem der sprichwörtliche Eisberg aus dem Nebel auftaucht – das Ding war die ganze Zeit über da, aber ich habe es einfach nicht gesehen. Und ich müsste lügen, wenn ich sagen wollte, ich wäre nicht frustriert.

Das Kugelmodell des Wissens

Nun müsste mir natürlich eigentlich klar sein, dass so etwas immer mal wieder passiert, wenn man mit offenem Geist durch die Welt geht. Schon vor vielen Jahren bin ich über das Kugelmodell des Wissens gestolpert, das das Phänomen wie folgt beschreibt:

Stellen wir uns vor, es gäbe da einen (unendlich großen) Raum angefüllt mit potentiellem Wissen. Und stellen wir uns weiter vor, unser tatsächliches Wissen sei eine Kugel in diesem Raum. Dann ist die Oberfläche dieser Kugel unsere Kontaktfläche mit unserem Unwissen.

Da die Kugel eines Ungebildeten klein ist, ist ihre Oberfläche es auch. Wer wenig weiß, sieht also auch wenig von dem, was er nicht weiß – er fühlt sich seiner Sache oft sicher, obwohl er im Grunde keinen Schimmer hat. Dieses Phänomen wird auch als Dunning-Kruger-Effekt bezeichnet und wird sicherlich irgendwann einmal Thema dieses Blogs sein. Dagegen hat die Kugel des umfassend Gebildeten eine große Oberfläche. Er weiß viel, ist sich aber auch vieler Dinge bewusst, die er noch nicht kennt oder verstanden hat. Im Sinne Sokrates‘ weiß er, dass (oder zumindest: wie viel) er nicht weiß.

Spezialisten…

Nichtsdestotrotz ist dieses Gefühl des Unwissens unangenehm. Unser Geist strebt ja danach, sich selbst als kompetent zu erleben, und paradoxerweise ist eine kleine Wissenskugel dafür besser geeignet als eine große.

Eine verbreitete Lösung dafür ist das Spezialistentum. Man wählt sich ein Spezialgebiet aus – sei es nun eine wissenschaftliche Disziplin, ein Handwerk oder einfach „Fußball“ – und wird darin richtig gut. Wenn man jetzt auch den dazu passenden Beruf ergreift, dann kann man sich die meiste Zeit des Tages über kompetent fühlen, was zu einer hohen Selbstwirksamkeitserwartung führt.

Ich selbst bin beispielsweise ein Informatiker, der sich in seiner Promotion auf Kryptografie spezialisiert hat. Oder noch genauer auf die Kryptoanalyse von Stromchiffren, was wiederum ein ziemlich kleines Teilgebiet ist. Hätte ich meinen Arbeitsschwerpunkt dort belassen, hätte ich mein Berufsleben mit dem Gefühl zubringen können, ein wirklich kompetenter Experte zu sein, der nicht nur alles weiß, was es zu seinem Thema zu wissen gibt, sondern der darüber hinaus auch von anderen als Koryphäe wahrgenommen wird.

Vielleicht darf ich an dieser Stelle eine kleine Anekdote einfügen. Im Jahre 2008 war ich auf einer Kryptographie-Tagung in einer kleinen Universitätsstadt in Kanada. Wir waren in Studentenwohnheimen in Zweierwohnungen untergebracht, und mein „Mitbewohner“ war ein junger Chinese, der zufälligerweise im gleichen Fachgebiet wie ich selbst arbeitete. Er zerfloss fast vor Ehrfurcht und begrüßte mich mit den Worten: „Sie sind der Erik Zenner? Ich habe alle ihre Papers gelesen!“ Ich dachte erst, er wolle mich auf den Arm nehmen, denn in der Welt der Kryptographie war ich ein eher kleines Licht, aber er meinte das völlig ernst. Wie sich herausstellte, bewegte er sich wissenschaftlich genau in der kleinen Nische, in der ich einige für Spezialisten interessante Ergebnisse zustande gebracht hatte, und wusste daher, wer ich bin. Tatsächlich verbrachte er auch die nächsten Jahre in dieser Nische – er überholte mich schon bald in Sachen Output und Reputation und wurde in diesem Spezialgebiet genau der Experte, der ich nicht hatte sein wollen.

Ich denke, dass das gerade in der Wissenschaftswelt, aber auch überall sonst häufig passiert. Spezialistentum ist ein guter Weg, um die eigenen kognitiven (und zeitlichen) Ressourcen zu bündeln, und es ist vermutlich auch der einzige Weg, um wissenschaftliche Disziplinen jenseits des Schwungs der Gründerjahre weiterzuentwickeln.

… und Generalisten

Schwierig wird es aber, wenn alle Spezialisten sein wollen. Dann bekommt man beim Verständnis der Welt das Problem, das das berühmte Gleichnis von den Blinden und dem Elefanten beschreibt: Jeder nimmt nur einen winzigen Teil des Ganzen wahr und versucht, daraus mit den Methoden seiner Disziplin eine Wahrheit abzuleiten.

Dieses Vorgehen mag funktionieren, solange man sich in abstrakten Modellen bewegt, aber für komplexe Zusammenhänge aus der wirklichen Welt ist es eher ungeeignet. Leider beobachten wir es aber in letzter Zeit immer häufiger, und zwar auch an Stellen, wo es Probleme nach sich zieht.

Das aktuellste Beispiel (und den Exkurs kann ich mir leider beim besten Willen nicht verkneifen) ist das einseitige Optimieren von Corona-Maßnahmen ausschließlich unter den Gesichtspunkten einer einzigen Wissenschaft, nämlich der Epidemologie. Dass es dabei haufenweise Kollateralschäden in unberücksichtigten Bereichen wie psychische und körperliche Gesundheit, Persönlichkeitsentwicklung, Risikoeinstellung, Bildung, privat- und volkswirtschaftliche Stabilität, Generationengerechtigkeit, Demokratieakzeptanz usw. geben würde, wurde früh von Experten anderer Disziplinen angemerkt, aber der Einfachheit halber ignoriert. Obwohl „Güterabwägung“ ein beliebtes Schlagwort in der Rechtslehre und der Ethik ist, weiß im Grunde niemand, wie man solch unterschiedliche Güter wirklich gegeneinander abwägen soll. Also lässt man es gleich ganz und befragt stattdessen den Wissenschaftler, dessen Thema gerade zuoberst auf der Tagesordnung liegt. Ein Informatiker würde hier von einem Greedy-Algorithmus sprechen, ein Entscheidungspsychologe von einer Take-the-Best-Heuristik. Beide wären sich aber darin einig, dass man solche Verfahren im Alltag nur einsetzen sollte, wenn die Entscheidung unbedeutend oder der Entscheider kognitiv überfordert ist, denn die Ergebnisse sind (von wenigen Ausnahmen abgesehen) alles andere als optimal.

Weisheit kann man verstehen als die Fähigkeit, auch in komplexen Situationen zu guten Entscheidungen zu kommen. Das erfordert aber ein gutes Verständnis aller beteiligten Disziplinen. Leider ist die Wissensfülle der Menschheit heutzutage jedoch so gewaltig, dass wohl kein lebender Mensch von sich behaupten kann, über alles benötigte Wissen zu verfügen.

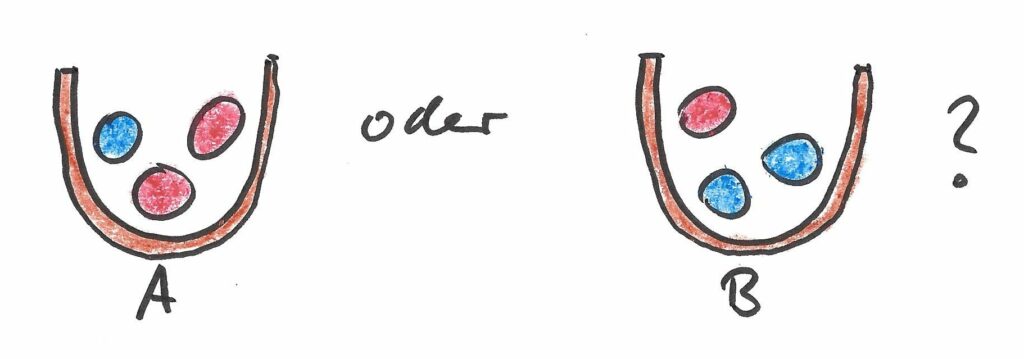

Was es bräuchte, wäre also ein gutes Zusammenspiel aus Spezialisten aus verschiedenen Disziplinen, und hier kommen die Generalisten ins Bild. Sie dienen als Vermittler zwischen den einzelnen Teilbereichen, als Übersetzer und Wissensüberträger. In der Network Science (von der wohl künftig noch häufiger die Rede sein wird) modelliert man Wissenschaftler als Knoten (Nodes) und eine Kooperationsbeziehung zwischen ihnen als Kanten (Links). Die daraus resultierenden Netzwerke besitzen dann typischerweise eine Struktur wie im folgenden Beispiel:

Man sieht, dass die Mehrzahl der Wissenschaftler in Clustern, die ihrer Community entsprechen, vernetzt sind. Sie sind Spezialisten, die über gemeinsames Wissen und gemeinsame Methoden verfügen. Vergleichsweise selten dagegen sehen wir Kanten zwischen verschiedenen Wissensgebieten, die auch Brücken genannt werden. Der Bau solcher Brücken ist die Stärke und auch die Rolle der Generalisten – sie sind weniger stark in einer einzigen Community vernetzt, stellen dafür aber die Schnittstelle zwischen verschiedenen Forschungsgemeinschaften und -themen bereit.

Und nun?

Für mich selbst ist es in Frust-Momenten wie dem obigen wichtig, mich daran zu erinnern, dass ich den Weg des Generalisten ganz bewusst gewählt habe. Ich sehe meine Stärke (und auch meine Berufung) heutzutage eher darin, mich in verschiedenen Disziplinen ordentlich auszukennen, interdisziplinäre Probleme zu lösen und Wissen zwischen den Communities zu transportieren. Und dazu gehört es eben auch, ein Stückweit ein „Universaldilettant“ zu sein, immer ein Stückweit ein Suchender und Fragender zu bleiben und manchmal sogar Wissens- und Verständnislücken zu offenbaren, die mich für den Spezialisten angreifbar machen.

Wenn ich so darüber nachdenke, beobachte ich eigentlich häufig, dass gerade die Gefahr des Offenbarens von Wissenslücken so gefürchtet ist, dass es zum Schweigen führt. So scheitert die Diskussion zwischen verschiedenen Communities oft gerade daran, dass die einen gar nicht verstehen, was die anderen sagen. Da sagt der Informatiker: „Dazu müsste man eigentlich nur eine Blockchain mit Proof of Stake einsetzen.“ Oder der Geisteswissenschaftler: „Habermas hat das doch in seiner Diskurstheorie klar herausgestellt“. Und niemand im Raum traut sich zuzugeben, dass er keine Ahnung hat, wovon hier die Rede ist.

Im Grunde müsste an der Stelle jemand den Mut haben aufzustehen und zu sagen: „Ich bin jetzt mal ehrlich – ich kenne mich damit nicht aus. Magst du das mal in fünf Minuten erklären?“ Und wer sollte das tun, wenn nicht der Generalist?

Denken Sie einmal darüber nach. Und wenn Sie beim bloßen Gedanken daran, dass Sie selbst sich in dieser Form vor versammelter Mannschaft als Unwissender „outen“ müssten, ein Gefühl des Unbehagens empfinden, dann verstehen Sie, warum echte Generalisten so selten sind…